Când John Brennan, alegerea președintelui Obama de a fi următorul șef al CIA, a apărut ieri în fața unei comisii a Senatului, o întrebare i-a înlocuit pe toți ceilalți la audierea sa de confirmare:

Cum sunt luate deciziile de trimitere a dronei ucigașe după teroristi suspecti?

Cum și, pentru asta, motivul pentru a comanda atacuri specifice drone rămâne în mare parte un mister, dar cel puțin un lucru este clar - deciziile sunt luate de oameni care, s-ar spera, se luptă cu gândul de a trimite o rachetă mortală într-o clădire ocupată.

Dar dacă oamenii nu ar fi implicați? Ce se întâmplă dacă deciziile legate de viață sau de moarte au fost lăsate la mașini echipate cu o mulțime de date, dar și un sentiment de corect și de greșit?

Cândal moral

Nu este atât de adus. Nu se va întâmpla în curând, dar nu există nicio întrebare că, pe măsură ce mașinile devin mai inteligente și mai autonome, o parte pivotă a transformării lor va fi capacitatea de a învăța moralitatea.

De fapt, s-ar putea să nu fie atât de departe. Gary Marcus, care a scris recent în The New Yorker, a prezentat scenariul uneia dintre mașinile fără șofer ale Google, înainte de a fi obligat să ia o decizie de a doua secțiune: „Mașina dvs. viteză de-a lungul unui pod, la 50 de mile pe oră, când autobuzul școlar errant transportă 40 de copii nevinovați. își traversează calea. Ar trebui ca mașina dvs. să se învârtă, riscând, eventual, viața proprietarului (dumneavoastră), pentru a salva copiii sau a continua, punând în pericol toți cei 40 de copii? Dacă decizia trebuie luată în milisecunde, computerul va trebui să apeleze. "

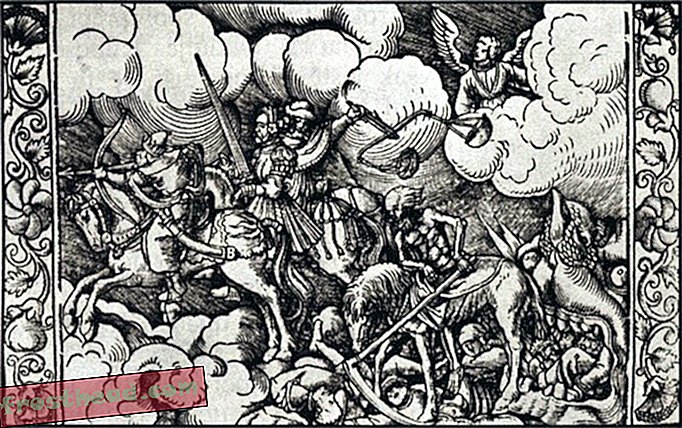

Dar armele robotizate sau soldații? Ar putea un drone să învețe să nu dea foc asupra unei case dacă știa că și civili nevinovați sunt în interior? Mașinile ar putea fi învățate să respecte regulile internaționale de război?

Ronald Arkin, profesor de informatică și expert în robotică la Georgia Tech, crede cu siguranță. El a dezvoltat un software, denumit „guvernator etic”, care ar face mașinile capabile să decidă când este potrivit să funcționeze și când nu.

Arkin recunoaște că acest lucru ar mai putea fi la câteva decenii distanță, dar consideră că roboții ar putea fi într-o bună zi atât fizici, cât și din punct de vedere etic față de soldații umani, nu sunt vulnerabili la traumele emoționale ale luptei sau la dorințele de răzbunare. El nu are în vedere o armată cu totul robot, dar una în care utilajele servesc împreună cu oamenii, făcând locuri de muncă cu risc ridicat, pline de decizii stresante, cum ar fi compensarea clădirilor.

Ferește-te de roboții ucigași

Dar alții simt că este timpul să stârnești acest tip de gândire înainte de a merge prea departe. La sfârșitul anului trecut, Human Rights Watch și Clinica pentru Drepturile Omului din Harvard Law School au emis un raport, „Pierderea umanității: cazul împotriva roboților ucigași”, care, drept titlul său, a cerut guvernelor să interzică toate armele autonome, deoarece „ar crește riscul de deces sau rănirea civililor în timpul conflictelor armate. "

Cam în același timp, un grup de profesori de la Universitatea Cambridge au anunțat planurile de a lansa ceea ce numesc Centrul pentru Studiul Riscului Existențial. Când se va deschide mai târziu în acest an, va impulsiona cercetări științifice serioase cu privire la ce s-ar putea întâmpla dacă și când mașinile devin mai inteligente decât noi.

Pericolul, spune Huw Price, unul dintre co-fondatorii Centrului, este că într-o bună zi am putea avea de-a face cu „mașini care nu sunt răuvoitoare, dar mașini ale căror interese nu ne includ”.

Arta înșelăciunii

Shades of Skynet, sistemul de inteligență artificială necinstit care a născut un cyborg Arnold Schwarzenegger în filmele The Terminator . Poate că acestea vor fi întotdeauna lucrurile de science-fiction.

Dar ia în considerare alte cercetări, Ronald Arkin face acum ca parte a proiectelor finanțate de Departamentul Apărării. El și colegii au studiat modul în care animalele se înșală reciproc, cu scopul de a învăța roboții arta înșelăciunii.

De exemplu, au lucrat la roboți de programare, astfel încât să poată, dacă este necesar, să se simtă tari, așa cum fac deseori animalele. Și au căutat mașini de predare pentru a imita comportamentul creaturilor precum veverița gri estică. Veverițele își ascund nucile de alte animale, iar când apar alte veverițe sau prădători, veverițele cenușii vor vizita uneori locuri unde obișnuiau să ascundă nuci pentru a-și arunca concurenții de pe pistă. Roboții programați pentru a urma o strategie similară au reușit să confunde și să încetinească concurenții.

Arkin este în interesul dezvoltării de mașini care nu vor reprezenta o amenințare pentru oameni, ci mai degrabă un atu, mai ales în urâtul haos al războiului. Cheia este să începeți să vă concentrați acum pe stabilirea orientărilor pentru comportamentul robotului adecvat.

„Când începi să deschizi acea cutie a Pandorei, ce trebuie făcut cu această nouă capacitate?”, A spus el într-un interviu recent. „Cred că există potențialul ca aceste roboți inteligenți să diminueze victime non-combatante, dar trebuie să fim foarte atenți la modul în care sunt folosiți și nu doar să-i eliberam pe câmpul de luptă fără îngrijorare adecvată.”

Pentru a-l crede pe scriitorul newyorkez Gary Marcus, mașinile avansate etic oferă un potențial mare dincolo de câmpul de luptă.

Gândul care mă bântuie cel mai mult este că etica umană în sine nu este decât o lucrare în progres. Ne confruntăm în continuare cu situații pentru care nu avem coduri bine dezvoltate (de exemplu, în cazul sinuciderii asistate) și nu trebuie să privim departe în trecut pentru a găsi cazuri în care propriile noastre coduri erau dubioase sau mai rău (de exemplu, legi care sclavie și segregare permise).

Ceea ce ne dorim cu adevărat sunt mașini care pot merge cu un pas mai departe, înzestrate nu numai cu cele mai solide coduri de etică pe care cei mai buni filosofi noștri contemporani le pot concepe, dar și cu posibilitatea ca mașinile să facă propriile lor progrese morale, aducându-le în trecut propriile noastre limită timpuriu -ideea de moralitate din secolul al XXI-lea.

Mașinile merg mai departe

Iată mai multe dezvoltări robotice mai recente:

- Hmmmm, etic și furios: Cercetătorii din Australia au dezvoltat un robot care se poate strecura mișcându-se doar atunci când există suficient zgomot de fundal pentru a-i acoperi sunetul.

- Care este acel sunet zgomotos ?: Soldații britanici din Afganistan au început să folosească drone de supraveghere care se pot încadra în palmele mâinilor. Numit Black Hornet Nano, micul robot are doar patru centimetri lungime, dar are o cameră de spion și poate zbura 30 de minute cu taxă completă.

- Zgârierea suprafeței: NASA dezvoltă un robot numit RASSOR, care cântărește doar 100 de kilograme, dar va putea minta minerale pe Lună și pe alte planete. Se poate deplasa pe teren accidentat și chiar peste îndrăznețe, sprijinindu-se în sus pe brațele sale.

- Ah, pofta: Iată o poveste timpurie de Ziua Îndrăgostiților. Oamenii de știință de la Universitatea din Tokyo au folosit o molie masculă pentru a conduce un robot. De fapt, au folosit mișcările sale de împerechere pentru a direcționa dispozitivul către un obiect parfumat cu feromoni de molie feminină.

Bonus video: Deci nu sunteți sigur că puteți opera un robot înalt de 13 metri? Nici o problema. Iată o demonstrație națională care vă arată cât de ușor poate fi. Un model fericit vă arată chiar cum să operați funcția „Smile Shot”. Zâmbești, dă foc BB-urilor. Cât de greu este?

Mai multe de pe Smithsonian.com

Acest robot este un tată mai bun decât tata

Roboții Obțineți atingerea umană